14-12-2023

Op donderdag 14 december vond de Conferentie Waardengedreven Digitalisering – Generatieve AI plaats in samenwerking met het ministerie van Binnenlandse Zaken en Koninkrijksrelaties (BZK).

De conferentie stond in het teken van de dialogen die zijn gevoerd met de Aanpak Begeleidingsethiek van ECP rondom (mogelijke) toepassingen van generatieve artificiële intelligentie (GAI). Deze vonden plaats in het kader van de Werkagenda Waardengedreven Digitaliseren van BZK en zijn input voor het visiedocument AI dat begin 2024 wordt gepubliceerd.

Waar en hoe wordt GAI al gebruikt? Welke effecten zien mensen die er in de dagelijkse praktijk mee te maken hebben? Welke waarden spelen een rol bij de toepassing van GAI? En welke handelingsopties zijn er om die waarden dichterbij te brengen?

Bekijk de Conferentie terug op de onderstaande video

Waardengedreven Digitalisering & Visie AI

In een bomvolle zaal opende Wouter Welling, MT-lid digitale samenleving bij BZK, de conferentie. Digitalisering vraagt om een waardengedreven aanpak. Het gaat daarbij niet alleen om het oplossen van problemen met behulp van digitalisering, maar om de vraag: wat is de impact van digitalisering op onze maatschappij?

De Werkagenda is een eerste stap voor de waardengedreven digitale transitie van Nederland. Publieke waarden vormen steeds het uitgangspunt bij afwegingen in beleid, zowel voor de kansen (stuwende waarden) als zorgen (verankerde waarden) rondom digitalisering. Een voorbeeld daarvan is het Algoritmeregister, waarbij publieke waarden als transparantie, autonomie en innovatie en veiligheid, inclusie en uitvoerbaarheid ten grondslag liggen aan het beleid. Bekijk hier de presentatie van Wouter Welling.

Jasper Kars, beleidsmedewerker Data en AI bij BZK, nam het stokje van Wouter Welling over en lichtte de ontwikkeling van de visie op AI toe. Technologie is niet waardenvrij en technologie en de mens kunnen niet los van elkaar worden gezien. Daarom is aandacht nodig voor de impact én handelingsperspectieven om ethisch verantwoord met generatieve AI om te gaan. Denk hierbij aan publieke waarden die op gespannen voet kunnen staan met generatieve AI: waar komen de data vandaan die ten grondslag liggen aan een AI-model? Is daar toestemming voor gegeven? In hoeverre is transparant hoe generatieve AI werkt? En hoe voorkom je bias en discriminatie in de output die door AI-modellen wordt gegenereerd? De overheid is aanzet om ervoor te zorgen dat deze technologie verantwoord kan worden ontwikkeld, gebruikt en geïmplementeerd.

Jasper Kars: “De begeleidingsethieksessies van ECP zijn bijzonder geschikt voor een open beleidstraject, zoals in het geval van de overheidsbrede visie op generatieve AI. Deze sessies brengen het essentiële gesprek over waarden in technologie vanuit abstractie concreet en maken de discussie, met nadruk op praktische toepassingen, zeer tastbaar.”

Horizontaal toezicht: aansluiten op de dynamiek van technologie en het goede doen

Daniël Tijink, programmadirecteur ethiek bij ECP, ging nader in op de Aanpak Begeleidingsethiek. De moderne techniekfilosofie gaat uit van verwevenheid tussen mens en technologie, in plaats van technologie als de ander te zien. Wij als mens vormen technologie en technologie vormt ons. We moeten ons daarom als mens bewust verhouden tot technologie, zo ook generatieve AI.

De Aanpak Begeleidingsethiek brengt mensen vanuit verschillende perspectieven bij elkaar rondom de (mogelijke) inzet van een technologie in een concrete context. Dus bottom-up. Zo demystificeer je (nieuwe) technologieën en organiseer je horizontaal toezicht. Dat is een interessante aanvulling op het vooral verticale toezicht zoals bijvoorbeeld bij de AI Act. Met verticaal toezicht maak je beleid dat algemeen is en dat moet worden toegepast op concrete toepassingen. Die vertaling is moeilijk. Horizontaal toezicht, bijvoorbeeld via begeleidingsethiek, begint juist bij de praktijk en laat mensen die erbij betrokken zijn of erdoor geraakt worden letterlijk ‘toezien’. In de sessie rondom ChatGPT waren dat bijvoorbeeld de student, de docent (professional), de examencommissie (beleid) en ook mensen vanuit de techniek. Door al die mensen tegelijk erbij te betrekken, krijg je een mooi beeld van de verschillende waarden én de handelingsperspectieven om die waarden te borgen in de technologie, de omgeving en hoe we ‘m gebruiken als mens. Het is praktische ethiek: het goede doen.

Bekijk hier de presentatie van Daniël Tijink.

Waardengedreven dialogen: de casussen rondom GAI

Bij het Leids Universitair Medisch Centrum (LUMC), RTL en Hogeschool Windesheim zijn toepassingen van generatieve AI verkend. Bij de Politie heeft een verkenning plaatsgevonden rondom een hypothetische casus. André Krom (senior onderzoeker en docent, LUMC), Sanne Eggengoor (datawetenschapper, RTL), Wieger van Dalen (docent beroepsethiek, Hogeschool Windesheim) en Manon den Dunnen (Strategisch specialist digitaal, Politie), gaven een toelichting op de (hypothetische) casussen die zijn verkend. De verslagen van de sessies zijn te vinden op www.begeleidingsethiek.nl

Bij het LUMC is gekeken naar Autoscriber; een generatieve AI tool die automatisch een transcriptie maakt van het arts-patiënt gesprek. André Krom lichtte toe dat het achterliggende idee van de inzet van deze tool tijdsefficiëntie is, en deze bespaarde tijd benut kan worden voor een betere kwaliteit van zorg. Samen met patiënten, zorgverleners, juristen en ethici en mensen van de tool Autoscriber is de dialoog aangegaan. Een belangrijke handelingsoptie gegeven het doel van de inzet van de tool is dat de bespaarde tijd niet vanzelf resulteert in een hogere kwaliteit van zorg; dat moet je organiseren. Een andere waarde die ter sprake kwam is inclusiviteit. Hoe werkt een automatische transcriptie als mensen met een dialect spreken en bij mensen die doof zijn? Ook privacy speelde een belangrijke rol. Vanuit het ICT-perspectief werd geopperd de volledige transcripten niet automatisch in het patiëntdossier te laden. Patiënten zelf gaven echter aan dat bij het slechts uploaden van de samenvatting het risico bestaat dat relevante details mogelijk verloren gaan.

Manon den Dunnen lichtte de hypothetische casus bij de Politie toe rondom chatbot Wout. Wout is een chatbot in de vorm van een cartoonavatar die burgers te woord staat. Tijdens de fictieve casus zijn de mogelijke effecten verkend van de inzet van een door generatieve AI gemaakte menselijke avatar met de achterliggende gedachte de interactie menselijker te maken. Den Dunnen benadrukt dat er bij de politie altijd de afweging wordt gemaakt of een nieuwe technologische innovatie ook echt gewenst is, naast dat het kan en mag. De sessie heeft geholpen afwegingen voor het voetlicht te brengen en de factoren die een rol spelen inzichtelijk te maken. De waarden inclusiviteit en authenticiteit zijn daarin erg belangrijk; mensen moeten zich kunnen herkennen in een avatar. In het verlengde daarvan zou een menselijke avatar andere verwachtingen kunnen scheppen dan bij een cartoon. Bij een mens verwacht je onderhandelingsruimte, de mogelijkheid om een gesprek aan te gaan. Uit onderzoek blijkt dat mensen bij een realistische avatar vergeten dat ze met een robot te maken hebben. Gelijkwaardigheid en vertrouwen zijn waarden die daar mogelijk door ondermijnd kunnen worden. De dialoog bevestigde daarom vooral de twijfels die er al waren: waarom zouden we dit willen doen? Niet alles wat kan is ook zinvol.

Bij Hogeschool Windesheim is het gesprek gevoerd over het gebruik van ChatGPT door studenten. Wieger van Dalen van Windesheim vertelde dat vrijwel alle studenten ChatGPT gebruiken om verslagen te maken, maar ook om interactief tentamens mee te leren en hun productiviteit te verhogen. De snelle adoptie van ChatGPT stelt het onderwijs voor een uitdaging. Wat hebben studenten te leren als ze het via een chatbot kunnen opvragen? Samen met docenten, studenten, het ministerie voor Onderwijs, Cultuur en Wetenschap, de examencommissie van Windesheim en BZK heeft men zich gebogen over de effecten van ChatGPT in het onderwijs. Ook examenfraude kwam aan bod. Een interessante conclusie daaromtrent was dat dat eigenlijk een klein probleem is. Wikipedia en de introductie van smart phones wierpen deze vraag ook op. Een veel fundamentelere vraag is wat studenten nog wel moeten leren, en als ze iets moeten kunnen, hoe leren ze dat dan op een fatsoenlijke manier? Daarvoor is nieuw onderwijs nodig. De opvallendste waarde was authenticiteit. Deze werd geponeerd door de examencommissie met betrekking tot de authenticiteit van het ingeleverde werk. De invulling van deze waarde verbreedde gedurende sessie naar authenticiteit in termen van jezelf kunnen zijn als beroepsoefenaar. En hoe draagt ChatGPT daar dan vervolgens aan bij?

Tot slot lichtte Sanne Eggengoor van RTL de casus toe rondom door generatieve AI gegenereerde reclames van sponsoren die voorafgaand aan een programma worden uitgezonden. Het productiemateriaal wordt nu gedeeltelijk automatisch gegenereerd met de tool mid journey. Door de reclames met generatieve AI te maken worden de productiekosten lager. Kosten voor acteurs en vakmensen in de productie worden hierdoor niet gemaakt. Tijdens de sessie, waar datawetenschappers, de juridische afdeling, corporate communicatie, het advertentieverkoopteam, gemeente Hilversum en TV-kijkers bij aanwezig waren, kwam werkgelegenheid dan ook ter sprake. De kosten voor ‘reguliere’ producties waren überhaupt niet bereikbaar geweest voor sommige sponsoren, waarmee dergelijke reclames met de inzet van GAI juist ook toegankelijk worden voor hen. Andere waarden die werden besproken zijn diversiteit en representativiteit. Hoe worden mensen afgebeeld en zijn ze wel representatief? En klopt die representatie dan met hoe de groep die het betreft gepresenteerd wil worden? Ook de transparantie over het gebruik van GAI kwam ter sprake. Met de introductie van de AI-Act wordt ook toegewerkt naar een watermerk zodat zichtbaar is dat het beelden van mensen betreft die met GAI zijn gemaakt.

Praktische wijsheid: de resultaten van de dialogen

Edwin Borst, moderator van de Aanpak Begeleidingsethiek, presenteerde de geëxtrapoleerde resultaten van de vier sessies. Tijdens de sessies zijn de effecten van GAI verkend door de betrokkenen vanuit die context. Achter effecten zijn waarden te vinden, die vervolgens kunnen worden geborgd binnen drie ethische ruimten: de technologie, de omgeving waarin die wordt geïmplementeerd en hoe we de technologie als mens gebruiken.

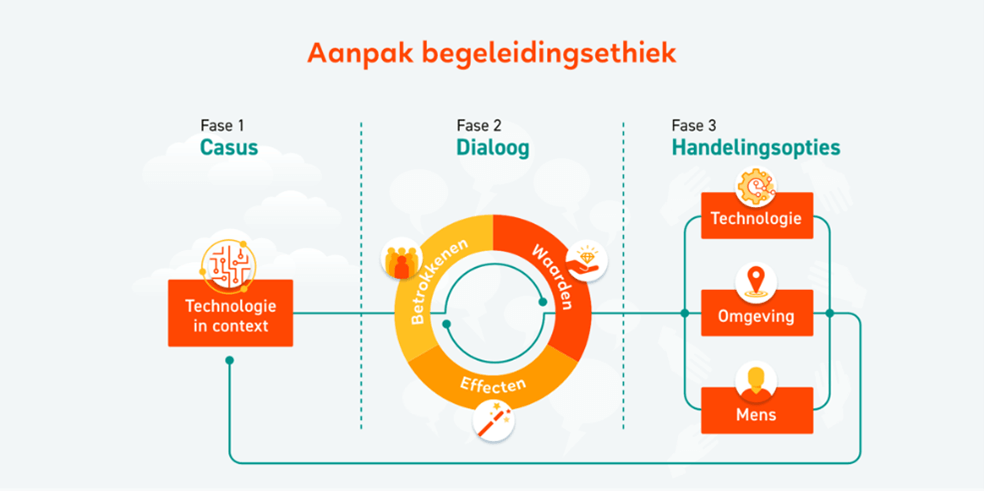

Figuur 1. De Aanpak Begeleidingsethiek: van een concrete technologische toepassing in een specifieke context (fase 1) kunnen samen met de betrokkenen de effecten voor het voetlicht worden gebracht. Daar zijn waarden achter te vinden (fase 2). Deze waarden kunnen vervolgens worden geborgd door (fase 3) de technologie conform die waarden te (her)ontwerpen, ze mee te nemen in de implementatie en in ons gebruik van de technologie als mens.

Welke waarden en handelingsopties zien we bij iedere sessie rondom GAI terugkomen? Er kunnen twee soorten waarden worden geïdentificeerd: enerzijds publieke waarden die worden geraakt door GAI (verankerde waarden) en anderzijds waarden waar GAI aan bijdraagt (stuwende waarden). Publieke waarden die bij alles sessies zijn genoemd betreffen: waarheid, privacy, inclusiviteit, diversiteit, verbondenheid, transparantie, onafhankelijkheid, eerlijke markt, beheersbaarheid, vertrouwen, verantwoordelijkheid en duurzaamheid. Bij stuwende waarden betreffen dat: effectiviteit, efficiëntie, creativiteit, werkgelegenheid, nieuwsgierigheid, persoonlijke ontwikkeling en kwaliteit.

Omdat deze waarden zijn opgehaald vanuit de praktijk, zijn ze geladen met effecten die vanuit die praktijk zichtbaar zijn geworden.

Publieke waarden |

Achterliggende effecten |

| Waarheid en authenticiteit | Technologie of uitkomsten zijn (on)waar (waarheid) of (on)echt (authenticiteit) |

| Transparantie | Gebrek aan transparantie over proces totstandkoming (transparantie) |

| representativiteit, gelijkheid, objectiviteit | Technologie of uitkomsten zijn (niet) representatief en (niet) neutraal (representativiteit, gelijkheid, objectiviteit) |

| Inclusiviteit | (Niet) iedereen doet mee (inclusiviteit) |

| onafhankelijkheid, eerlijke markt | Afhankelijk van grote techbedrijven (onafhankelijkheid, eerlijke markt) |

| Privacy | Schending privacy (privacy) |

| Duurzaamheid | Gebruik is (niet) duurzaam (duurzaamheid) |

Stuwende waarden |

Achterliggende effecten |

| Efficiëntie, effectiviteit, kwaliteit | Het wordt beter, sneller, goedkoper… (efficiëntie, effectiviteit, kwaliteit) |

| Kwaliteit, inclusiviteit | Soms wordt het zelfs te perfect (kwaliteit, inclusiviteit) |

| Persoonlijke ontwikkeling, gelijkheid | Emancipatie van de technische kluns c.q. digibeet (persoonlijke ontwikkeling, gelijkheid) |

| Diversiteit, effectiviteit, inclusiviteit | Alles kan op maat, gepersonaliseerd (diversiteit, effectiviteit, inclusiviteit) |

| Creativiteit | Creativiteit verandert van betekenis (creativiteit) |

| Verantwoordelijkheid, vakmanschap | Veranderende verhoudingen en rollen (verantwoordelijkheid, vakmanschap) |

| Beheersbaarheid | Nadruk op data (beheersbaarheid) |

Vanuit die waarden zijn door de betrokkenen handelingsopties ontworpen binnen de drie ethische ruimten. Hieronder worden enkele handelingsopties vanuit de hierboven benoemde waarden uiteengezet. De handelingsopties per sessie zijn terug te vinden in de verslagen die zijn gepubliceerd op https://begeleidingsethiek.nl/cases/.

Handelingsopties technologie |

Achterliggende waarde |

| Gebruik open source of bouw een eigen model | Onafhankelijkheid, transparantie |

| Maak gebruik van muliti-modaliteit; bijvoorbeeld het gebruik van een transcript als input om audio te maken voor mensen die niet kunnen lezen | Inclusiviteit |

Handelingsopties omgeving |

|

| Compenseer co2-uitstoot | Duurzaamheid |

| Leg uit hoe de toepassing werkt en waar de toepassing voor wordt gebruikt | Transparantie |

Handelingsopties mens |

|

| Leer medewerkers de mogelijkheden die de technologie brengt | Persoonlijke ontwikkeling, gelijkheid |

| Zorg voor diverse ontwikkelaars | Gelijke markt, kwaliteit, inclusiviteit |

Bekijk hier de presentatie van Edwin Borst.

Bredere dialoog: panelgesprek

Tijdens het panelgesprek werd gereflecteerd op wat de sessies de deelnemers hebben gebracht. De panelleden gaven aan dat de concrete casus als uitgangspunt ervoor zorgde dat de toepassing van GAI echt ging leven.

Sanne Eggengoor van RTL stipte aan dat de sessie leidde tot levendige dialogen waarin veel nieuwe input de revue passeerde. Vanuit Jasper Kars van BZK werd aangegeven dat de sessies voor hem het hoogtepunt waren van het visietraject en het waardevol was bij meerdere sessies rondom dezelfde technologie te zijn: je ziet bepaalde effecten en waarden over de verschillende sessies heen terugkomen, waardoor je kunt gaan toetsen. De methode heeft voor hen meerwaarde ten opzichte van alleen expertadvies inwinnen. Ook Koen Bonenkamp van Autoscriber, de tool die verkennend wordt ingezet bij het LUMC, neemt de uitkomsten van de sessie mee. Een voorbeeld daarvan is de mogelijkheid om live te kunnen vertalen voor de arts indien een patiënt geen Nederlands spreekt om inclusiviteit te borgen. Roland Gerbers, student bij Hogeschool Windesheim stond er initieel sceptisch in, maar heeft de sessie als waardevol en bovendien erg leuk ervaren. Een mogelijkheid om autonomie voor docenten te borgen is een eigen chatbot per opleiding te maken, zodat de docent de data-invoer kan beheersen en studenten nog steeds gebruik kunnen maken van GAI; socratische AI.

Ter illustratie van een sessie Begeleidingsethiek is onderstaande video te bekijken van de casus die bij Hogeschool Windesheim is verkend. Meer informatie over de Aanpak Begeleidingsethiek is te vinden op www.begeleidingsethiek.nl.

Begeleidingsethiek – Generatieve AI on Vimeo

De volledige conferentie is opgenomen en terug te kijken via deze link.

Aanpak Begeleidingsethiek

Chatbots, AI-assistenten, drones, elektronische patiëntendossiers… Tegenwoordig zijn er steeds meer nieuwe technologische toepassingen beschikbaar. Technologieën met kansen en risico’s die voor elk... + Meer over Aanpak Begeleidingsethiek