Conclusies

- Juridische en handhavingsmaatregelen: De AI Act heeft een juridische definitie van deepfakes geïntroduceerd. Het is nu aan de autoriteiten en sector om gezamenlijk het misbruik van deepfake technologie aan te pakken.

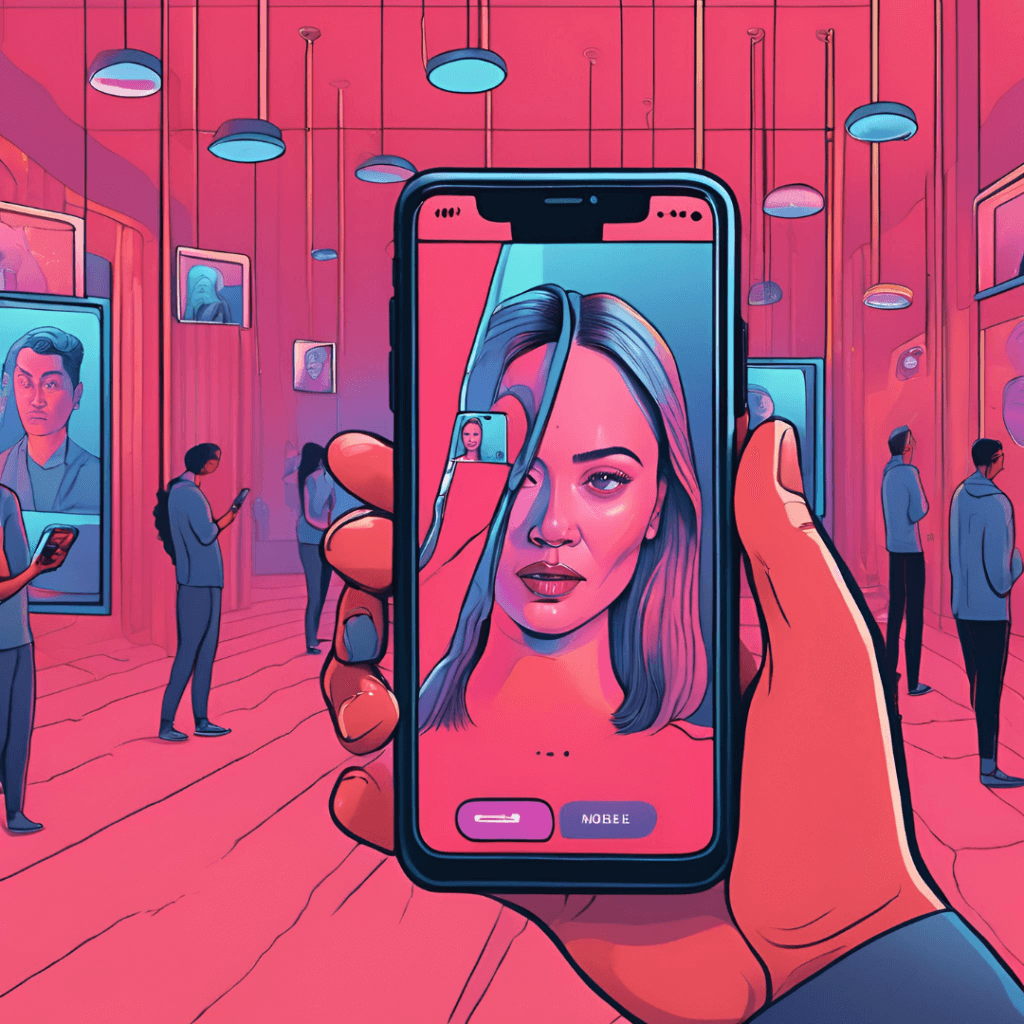

- Misbruik van deepfake technologie: Een groot deel van de deepfakes (98%) is pornografisch materiaal, vaak zonder toestemming gemaakt. Dit benadrukt de noodzaak van juridische maatregelen en samenwerking om misbruik aan te pakken.

- Belangrijke rol ATKM: de ATKM heeft een cruciale rol binnen het stelsel om online illegale (deepfake) content zo snel mogelijk van het internet af te krijgen. De content die niet onder terroristisch of kinderpornografisch materiaal valt, blijft echter nog een grote uitdaging.

Samenvatting

In deze sessie stond deepfake technologie centraal en werd er juridisch en met oog op samenwerking gekeken naar de aanpak van misbruik van deze technologie. En dat is hard nodig. Hanna van Til Advocaat – Boekx Advocaten) vertelde dat maar liefst 98% van de deepfakes pornografisch materiaal is, waarvan een groot deel zonder goedkeuring wordt gemaakt. Er was tot voor kort nog geen juridische definitie van deepfakes, maar de AI Act heeft daar verandering in gebracht. Zo heeft Boekx advocaten een handhavingsverzoek verstuurd naar de Autoriteit Persoonsgegevens voor een website waar veel deepfake porno op staat van bekende Nederlanders en het daarnaast ook nog laagdrempelig is om zelf deepfake porno te maken. Deze website trekt enorm veel bezoekers met in Nederland alleen al meer dan 200.000 bezoekers. De slachtoffers weten zelf vaak niet dat ze op deze websites staan en dat vraagt om gezamenlijke actie en onderstreept het belang van handhaving.

Folkert ter Bekke (Bestuurder primaire processen – ATKM) deelde vervolgens hoe zij hun rol als autoriteit invullen door nauw samen te werken met de sector en niet alleen gebruik te maken van de stok om mee te slaan maar ook de metaforische wortel onder de aandacht te brengen. Hij benadrukte dat het voor de ATKM niet uitmaakt of content gegenereerd is of niet omdat zij kijken naar de content zelf en of die als terroristisch of kinderpornografisch wordt beoordeeld.

“De ATKM werkt actief samen met de sector via onze sectorraad om de uitdagingen binnen de sector goed te begrijpen en zo snel mogelijk te kunnen schakelen.” – Folkert ter Bekke, ATKM

Michiel Steltman blikte terug naar 2014, toen de sector samen afspraken maakte over Child Sexual Abuse Material (CSAM). Hij vertelde hoe ingewikkeld het kan zijn voor kleine partijen om deze verantwoordelijkheid te dragen en het spanningsveld met andere regelgeving zoals de e-commerce directive. Na onderzoek van de TU Delft kwam naar voren dat er uiteindelijk een handjevol ‘bad hosters’ overbleven na kennisgeving over illegale content. Deze inzet was enorm effectief binnen Nederland maar dat zorgde ook voor een waterbed effect. Daarom is het belangrijk om deze werkwijze ook internationaal onder de aandacht te brengen.

“Er is een stelsel aan het ontstaan voor de aanpak van deze illegale content en dat vraagt om duurzame financiering van belangrijke organisaties binnen dit stelsel” – Michiel Steltman, DINL